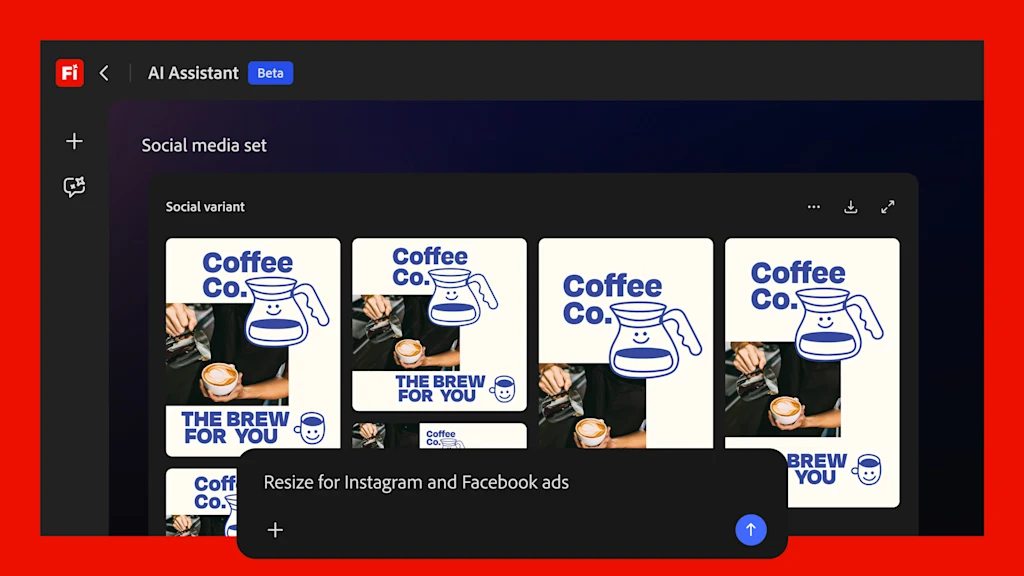

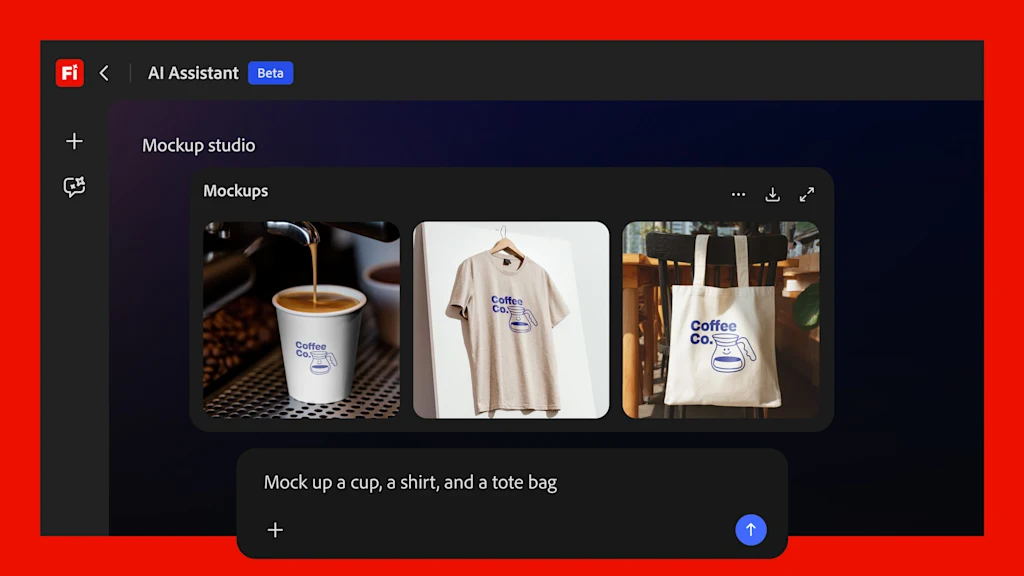

Adobe rolt de publieke bèta uit voor zijn Firefly AI Assistant, die later deze maand complexe creatieve workflows omzet in een eenvoudige chatinterface in applicaties als Photoshop, Premiere, Illustrator of Lightroom. Je typt wat je wilt, en de AI verbindt de punten achter de schermen om het te laten gebeuren. Omdat het een multimodale interface is, kan deze indien nodig nauwkeurig worden afgestemd via contextbewuste bedieningspanelen, buiten de tekstgebaseerde prompt. Het is een eerste stap in wat creatieve apps in de toekomst kunnen worden, waarbij de complexiteit van gebruikersinterfaces wordt weggenomen en de krachtige controle behouden blijft.

Als het eindproduct werkt zoals de demo, zal de nieuwe Firefly AI Assistant de fundamentele manier veranderen waarop mensen omgaan met ontwerpsoftware, door de sleutels van het ommuurde professionele creatieve kasteel te geven aan iedereen die bereid is het geld te betalen, in gewoon Engels te schrijven en schuifregelaars te verplaatsen die contextueel verschijnen om aspecten van hun creaties fijn af te stemmen wanneer dat nodig is. In plaats van nieuwkomers te dwingen een labyrint van menu’s, geneste paletten en pop-upvensters uit het hoofd te leren, laat de assistent hen complexe resultaten bereiken door simpelweg te vragen.

Tegelijkertijd is de nieuwe assistent de eerste opstap naar een nieuw soort automatisering voor professionals. Het geeft veteranen een snelle manier om het saaie gruntwerk te omzeilen waarvan ze al weten hoe het moet. “We hebben het volledige spectrum van mensen die nieuw zijn in onze franchise en die de volledige kracht van Photoshop niet kennen en een aantal fantastische bewerkingen willen maken. Ze kunnen er ook gebruik van maken en gewoon met de assistent praten”, vertelde Adobe vice-president van AI en innovatie Alexandru Costin me in een interview. “Aan de andere kant van het spectrum kunnen de creatieve professionals die onze tools volledig begrijpen, deze middelen daadwerkelijk overnemen en ze in onze tools blijven bewerken.”

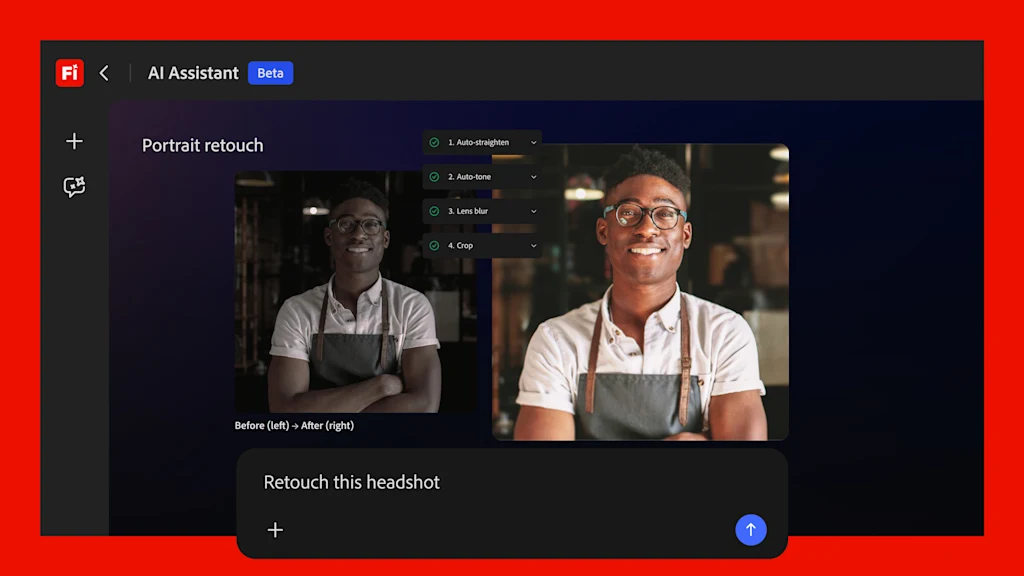

Deze tool is voortgekomen uit Project Moonlight, dat Adobe vorig jaar op de MAX-conferentie plaagde en testte in een privébèta. Het kernidee kwam rechtstreeks van werkende professionals die op zoek waren naar een moderne upgrade van Photoshop Actions, een decennia oude functie waarmee gebruikers muisklikken kunnen opnemen en opnieuw afspelen. Acties werken alleen voor vaste, herhaalbare klusjes, zoals het aanpassen van de tint en verzadiging van duizend afbeeldingen met behulp van vaste waarden. Maar gebruikers wilden een slimmer type automatiseringsagent die zich kon aanpassen aan wat de agent in elke afbeelding, video of illustratie ziet. Adobe besloot iets te creëren dat verder gaat dan de basisbewerking, door dingen op de media te veranderen op basis van de context en inhoud van de afbeelding of de video zelf, en zelfs nieuwe afbeeldingen, mockups en uiteindelijke kandidaten voor kunst te creëren.

De nieuwe, slimme ‘Photoshop Actions’

“Bij Adobe MAX ontmoette ik eigenlijk een grote groep professionals om hen te vragen over agentic”, vertelt Costin, waarbij hij de brancheterm gebruikt voor een AI die namens jou actief taken in meerdere stappen uitvoert in verschillende software. “Ze zeiden: ‘Kijk, ik zou het leuk vinden als jullie mij een knop zouden geven, zoals Photoshop-acties, waarmee ik in een agent kan opnemen wat ik aan het doen ben en de agent dat vervolgens voor mij kan laten afspelen, zodat ik in principe kan beslissen… dat deze automatisering de dingen op mijn manier doet.'”

Hoewel de nieuwe Firefly AI Assistant nog steeds twee beperkingen heeft die hem niet tot een directe vervanging van Actions maken (hierover later meer), heeft hij zeker het potentieel om een enorme tijdsbesparing te worden voor elke professional die met een ploeg AI-bots wil werken.

Om dat soort automatisering mogelijk te maken, heeft Adobe Creative Skills ontwikkeld. De AI leert in de loop van de tijd hoe een specifieke maker graag werkt, pikt zijn favoriete tools en visuele stijl op en kan die kennis toepassen om met uw bestanden om te gaan. “Je kunt je specifieke smaak of aanpak als creatieve professional beschrijven en die vervolgens ‘herhalen’ met het Firefly AI-systeem, zodat je tijd bespaart en een deel van je werk kunt automatiseren, zodat je meer tijd hebt voor creativiteit”, zegt Costin.

De huidige bèta biedt een standaardset standaardvaardigheden om mee te beginnen, maar het volledig bewerkbaar en deelbaar maken van deze vaardigheden komt in een volgende versie (een van de beperkingen die het onderscheidt van Photoshop Actions, die volledig deelbaar zijn).

In plaats van te vertrouwen op rigide sjablonen, fungeert het systeem als een autonome digitale art director. Het evalueert actief de grondstoffen op uw canvas om de juiste context te achterhalen voordat u een zet doet, in plaats van alleen maar blinde opdrachten uit te voeren op basis van bestandsmetagegevens. De software kaapt ook niet alleen uw cursor; het neemt voortdurend contact met u op om duidelijk te maken wat u eigenlijk wilt bereiken, zodat u de drijvende kracht blijft achter het uiteindelijke kunstwerk.

Deze integratie gaat verder dan de eigen motoren van Adobe en breidt het platform uit naar toonaangevende AI-modellen van derden, waaronder Claude van Anthropic. Het sluit ook aan op beoordelingsplatforms zoals Frame.io. Als een klant aantekeningen achterlaat over een project, kan de agent die feedback verwerken en de revisies zelf uitvoeren, waarbij hij de software selecteert die de klus het beste aankan.

Het pad voor adaptieve interfaces met meerdere modellen

De assistent introduceert ook Precision Flow, waarmee het vervelende karwei van het schilderen van pixel-perfecte maskers wordt vervangen door semantische bewerking. In plaats van met ruwe pixels om te gaan, herkent de AI de werkelijke fysieke objecten binnen het frame, wetende dat een koffiekopje een kopje is en de bonen ernaast bonen zijn. “Precision Flow geeft je de mogelijkheid om generatieve AI te gebruiken om een asset niet op pixelniveau, maar op de semantische kant te bewerken”, zegt Costin. “Zoals in dit geval weet het dat dit een foto is van koffie met koffiebonen, dus creëert het dynamische semantische schuifregelaars waarmee je je afbeelding semantisch kunt wijzigen zonder dat je er opnieuw om hoeft te vragen.”

Deze semantische mogelijkheid genereert automatisch nieuwe bedieningspanelen voor gedetailleerde controle. In het geval van het koffiekopje met de koffiebonen die over de vloeibare koffie spatten, zien gebruikers een paneel met schuifregelaars zoals ‘Koffiebonen’ en ‘Splash’ die gebruikers kunnen verplaatsen om de hoeveelheid bonen of koffiespatten nauwkeurig te verhogen of te verlagen. Dit is de juiste stap voor toekomstige apps. Natuurlijke taal is een prima uitgangspunt, maar taal is van nature interpreteerbaar, wat leidt tot onnauwkeurigheid en misverstanden. Er zit geen onnauwkeurigheid in een schuifregelaar die de hoeveelheid koffiebonen in het beeld interactief en in realtime kan vergroten.

Omdat de assistent rechtstreeks in de Creative Cloud is aangesloten, worden standaardtools zoals tint en verzadiging rechtstreeks doorgegeven aan de hosttoepassing. Het resultaat is geen dood afbeeldingsbestand; het genereert een native PSD-document, het standaardbestandsformaat van Adobe dat individuele bewerkingen op afzonderlijke, aanpasbare lagen stapelt.

“Dit is eigenlijk een Photoshop-besturingselement waarbij we, zodra je deze bewerkingen achter de schermen uitvoert, daadwerkelijk de PSD kunnen maken en die PSD in Photoshop wordt geladen”, zegt Costin. “Als je een echte Photoshop-functie gebruikt, wordt de volledige aanpassingslaag in Photoshop toegepast.”

De huidige bèta stuit echter nog steeds op een harde muur als het gaat om die geavanceerde semantische bewerkingen. Hoewel elk regulier regelpaneel, zoals HUE & Saturation, een bewerkbare laag in Photoshop genereert, worden die specifieke wijzigingen nog niet in Photoshop overgedragen als live, manipuleerbare schuifregelaars wanneer u Precision Flow gebruikt om objecten in de assistent aan te passen. “We hebben Precision Flow nog niet in Photoshop geïntegreerd. Je kunt je voorstellen dat dit ook naar Photoshop komt, maar ik denk niet dat we het nog aankondigen”, zegt Costin. “Als je deze bewerkingen nu uitvoert, is de afbeelding die aan Photoshop wordt doorgegeven een rasterafbeelding.”

Dat betekent dat de semantische aanpassingen aankomen als een afgeplatte, niet-bewerkbare laag pixels. Voor absolute beginners zal deze technische hindernis er niet zoveel toe doen, zolang het uiteindelijke beeld er maar goed uitziet. Voor de high-end professionals die Adobe voor het gerecht probeert te brengen, vermoed ik dat het eerder een tijdelijk ongemak zal zijn. Het zou heel fijn zijn om het te hebben, maar ik kan ook zonder werken.

Het is duidelijk dat de Firefly AI Assistant een enorme stap voorwaarts kan zijn om software voor de gebruiker te laten werken in plaats van andersom, waarbij je een AI opdracht geeft om te doen wat je wilt, waarbij de AI jouw werkstijl leert en alleen nauwkeurige bedieningselementen naar boven brengt wanneer dat nodig is.