Twee nieuwe experimenten laten zien dat de meeste mensen denk er niet eens over na dat een persoonlijke boodschap kan zijn AI-gegenereerd, zelfs als ze er zelf gebruik van maken kunstmatige intelligentie schrijven.

Om te zien hoe mensen iemand beoordelen op basis van wat ze in de leeftijd van ChatGPTmijn collega Jiaqi Zhu en ik rekruteerde meer dan 1.300 Amerikaanse deelnemers in de leeftijd van 18 tot 84 jaar en liet hen door AI gegenereerde berichten zien, zoals een verontschuldiging in een e-mail. We verdeelden onze vrijwilligers in vier groepen: Sommige mensen zagen de berichten zonder informatie over wie of wat ze schreef, zoals in het dagelijks leven. Anderen kregen te horen dat de berichten beslist door een mens waren geschreven, beslist door AI waren gegenereerd, of dat de bron een van beide zou kunnen zijn.

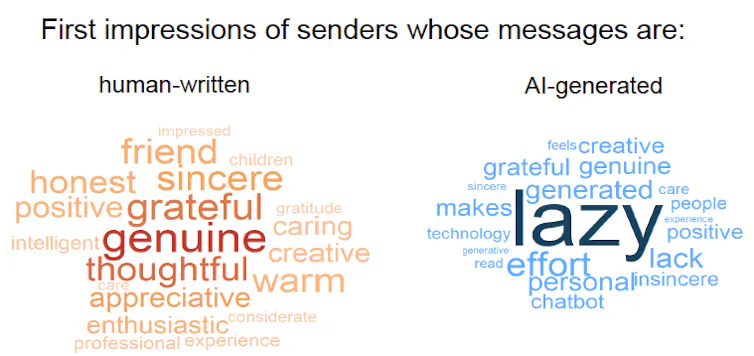

We vonden een duidelijke “AI-openbaarmakingsboete.” Als mensen wisten dat een bericht door AI was gegenereerd, beoordeelden ze de afzender veel negatiever (‘lui’, ‘onoprecht’, ‘gebrek aan inspanning’) dan wanneer ze geloofden dat dezelfde tekst door een persoon was geschreven (‘oprecht’, ‘dankbaar’, ‘attent’).

Maar hier is de twist: de deelnemers aan wie niets over auteurschap werd verteld, vormden indrukken die net zo positief waren als die van mensen aan wie werd verteld dat de berichten echt menselijk waren.

Dit totale gebrek aan scepticisme heeft ons verrast – en het roept nieuwe vragen op. Misschien waren de deelnemers niet voldoende bekend met AI om te beseffen dat de modellen van vandaag gedetailleerde en persoonlijke boodschappen kunnen produceren. (Dat kunnen ze.) Of misschien hebben deelnemers zelf nog nooit AI gebruikt. (Waarschijnlijk wel.) Daarom hebben we ook getest of het eigen AI-gebruik van de deelnemers de manier veranderde waarop zij afzenders beoordeelden.

Tot onze nog grotere verrassing vonden we weinig tot geen effect. Mensen die generatieve AI vrij vaak gebruiken in hun dagelijks leven – tenminste om de dag – hebben het gebruik van AI iets minder bestraft als het auteurschap van AI bekend werd gemaakt, vergeleken met mensen die nooit of zelden AI gebruiken. Maar de deelnemers waren standaard niet sceptischer: als het auteurschap niet openbaar werd gemaakt, hadden zware AI-gebruikers, lichte AI-gebruikers en niet-gebruikers allemaal de neiging om aan te nemen dat de tekst door een persoon was geschreven en vormden ze in wezen dezelfde indrukken.

Waarom het ertoe doet

Gebrek aan scepsis en een gebrek aan negatieve indrukken zijn belangrijk omdat mensen die maken sociale oordelen voortdurend uit tekst. Ontvangers overwegen de tijd en moeite te nemen om schriftelijke berichten te verzenden een inzicht in de oprechtheid, authenticiteit of competentie van de schrijver, en die indrukken, bepalen de beslissingen van mensen op het gebied van vriendschappen, daten en werk.

Toch laten onze belangrijkste bevindingen een opvallend verschil zien: mensen vermoeden het gebruik van AI doorgaans pas als het daadwerkelijk wordt gebruikt is duidelijk. Deze onwetendheid creëert een moreel dilemma: mensen die AI in het geheim gebruiken, kunnen van de voordelen genieten terwijl ze vrijwel geen risico lopen ontdekt te worden. Ondertussen, paradoxaal genoeg, zijn er mensen die vooraan staan en toegeven dat ze AI gebruiken reputatieschade lijden.

Na verloop van tijd zou een gebrek aan scepticisme en bewustzijn de betekenis van schrijven in het dagelijks leven kunnen veranderen. Lezers zouden kunnen leren schrijven te behandelen als een minder betrouwbaar signaal van iemands karakter of inspanning, en in plaats daarvan vertrouwen op andere vormen van communicatie. Het wijdverbreide gebruik van AI heeft werkgevers er bijvoorbeeld al toe aangezet de waarde ervan buiten beschouwing te laten sollicitatiebrieven van sollicitanten. In plaats daarvan zijn ze dat meer vertrouwen op persoonlijke aanbevelingen van de huidige supervisor van een sollicitant of op verbindingen die zijn gelegd via persoonlijke netwerken.

Welk ander onderzoek wordt er gedaan

Andere onderzoekers hebben een breed scala aan negatieve indrukken gedocumenteerd over mensen die hun AI-gebruik openbaar maken. Uit onderzoek blijkt dat sollicitanten erdoor lijken minder wenselijk en medewerkers lijken minder competent. Lezers van creatief schrijven beschouwen AI-gebruikers als minder creatief en niet authentiek. Mensen zien persoonlijke excuses En excuses van het bedrijfsleven die voortkomen uit AI als minder effectief. Over het algemeen het openbaar maken van AI-gebruik vermindert het vertrouwen en ondermijnt de legitimiteit.

Maar zonder openbaarmaking is er duidelijk bewijs dat de meeste mensen dat wel doen kan niet betrouwbaar worden gedetecteerd Door AI gegenereerde tekst, zelfs met de hulp van detectiemiddelenvooral wanneer de tekst is een mix van door mensen geschreven en door AI gegenereerde inhoud. Zelfs als mensen vertrouwen hebben in hun vermogen om AI-tekst te herkennen, is hun vertrouwen misschien niets meer dan een zelfbevestigende illusie.

Wat is het volgende

Ook al brachten onze experimenten geen vermoedens van AI-gebruik aan het licht, dat betekent niet dat mensen het in de echte wereld nooit vermoeden. In sommige situaties zijn mensen misschien al hyperwaakzaam als het om AI gaat. Gebruik in de academische wereld is een duidelijk voorbeeld. In onze volgende onderzoeken willen we begrijpen wanneer en waarom mensen op natuurlijke wijze het gebruik van AI beginnen te vermoeden, en wat de omslag tussen vertrouwen en twijfel doet omslaan.

Tot die tijd, als u wilt dat uw persoonlijke boodschap als oprecht wordt beoordeeld, kan de veiligste strategie zijn om te bellen, een voicemail in te spreken of, beter nog, om deze persoonlijk uit te spreken.

De Onderzoekskorting is een korte kijk op interessant academisch werk.

De wolken van anderen is assistent-professor psychologie aan de Universiteit van Amsterdam Universiteit van Michigan.

Dit artikel is opnieuw gepubliceerd van Het gesprek onder een Creative Commons-licentie. Lees de origineel artikel.