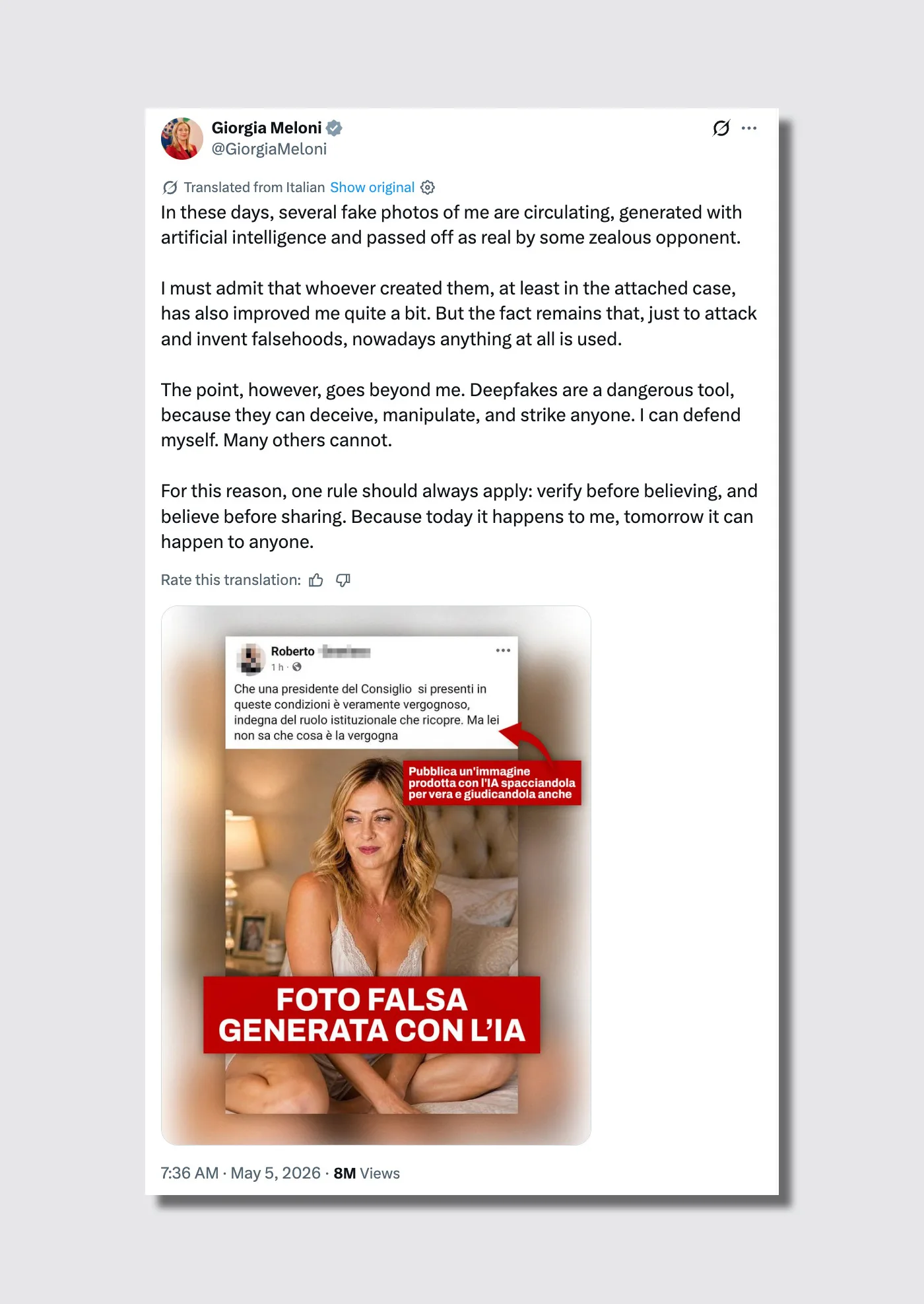

Gisteren, Giorgia Meloni gepost aan X een AI-gegenereerde foto van zichzelf terwijl ze alleen lingerie draagt. De Italiaanse premier publiceerde de afbeelding om anderen te waarschuwen voor hoe gemakkelijk het is om deze te creëren perfect geloofwaardige afbeeldingen en video’s. Haar waarschuwing: geloof nooit iets wat je ziet zonder het grondig te controleren.

Immers, we leven in het einde van de realiteit.

“Deepfakes zijn een gevaarlijk instrument, omdat ze iedereen kunnen misleiden, manipuleren en raken”, zei Meloni op X. “Ik kan mezelf verdedigen. Veel anderen doen dat niet.”

Ze heeft gelijk, ook al is het beeld technisch gezien geen deepfake. Het is een volledig door AI gegenereerde foto waarop haar gezicht te zien is. In tegenstelling tot vroege deepfakes, waarbij simpelweg het gezicht van een mens op een basisfoto werd verwisseld met het gezicht van een ander mens, kan generatieve AI verschillende componenten gebruiken – zoals echte gezichten, lichamen, plaatsen, stemmen en geluiden – om 100% nieuwe synthetische media te creëren.

Dit proces maakt de ware aard ervan vrijwel, zo niet volledig, niet detecteerbaar: aangezien je niet omgekeerd kunt zoeken en de basisafbeelding kunt matchen met een originele bron op internet, zou je kunnen geloven dat deze origineel (en echt) is.

Meloni heeft heeft al twee mannen aangeklaagd voor het maken van een deepfake-pornovideo van haar in 2024. Deze keer grapte ze dat de vervalsingen er “een stuk” beter uitzien dan zij en plaatste de afbeelding als een PSA uit 2026. “Dit is de reden waarom er altijd een regel moet gelden: controleer voordat je het gelooft, en geloof voordat je het deelt. Want vandaag overkomt het mij; morgen kan het iedereen overkomen”, schreef ze.

Meloni toonde moed door zichzelf op de voorgrond te plaatsen, maar er moet meer worden gedaan dan alleen advies uitdelen. Wij zijn manier voorbij het punt van onderwijs. De wereld heeft actie nodig.

Generatieve AI vormt een existentieel gevaar voor de mensheid. Het kan onze psychologische vooroordelen bewapenen en ons gedeelde gevoel van objectieve realiteit effectief vernietigen.

Kijk maar eens naar wat er de afgelopen maanden is gebeurd. Er is Jessica Foster, een door AI gegenereerde, pro-Trump militaire beïnvloeder die in slechts drie maanden tijd een miljoen volgers verzamelde om mannen naar een volwassen fetisjsite te leiden (haar account verscheen later verwijderd van Instagram). En ook al was Foster’s digitale persoonlijkheid bezaaid met duidelijke weergavefouten en absurde scenario’s, in tegenstelling tot Meloni’s beelden negeerden haar volgelingen deze moedwillig omdat de luchtspiegeling perfect hun ideologische fantasieën bevredigde.

Toen een legitieme video werd vrijgegeven waaruit blijkt dat de Israëlische premier Benjamin Netanyahu nog leefde Na geruchten over moord heeft het internet – geholpen door hallucinerende AI-chatbots – de beelden onmiddellijk en ten onrechte afgedaan als deepfake. Zelfs nadat onafhankelijke analisten en factcheckers onweerlegbaar bewijs hadden geleverd dat de video authentiek was, kon het bewijs degenen die de voorkeur gaven aan hun eigen complottheorieën niet overtuigen.

Iedere politicus moet nu actie ondernemen

Gevangen in deze onwerkelijke dystopie waarin de grenzen van de objectieve waarheid volledig zijn verdampt door technologiegiganten, heeft de samenleving meer nodig dan een X-post. Publieke bewustmakings- en voorlichtingscampagnes zijn niet langer voldoende om de enorme menselijke en economische gevolgen te bestrijden economische kosten die dit nu al veroorzaakt.

De enige resterende exitstrategie om onze gedeelde realiteit te redden is dat mondiale overheden agressief ingrijpen en technologiebedrijven dwingen hardware en software te adopteren die echte foto’s, video’s en audio zonder enige twijfel kunnen authenticeren.

In maart kwam een team van ETH Zürich voorgesteld de enige oplossing die serieus genoeg lijkt voor de omvang van de dreiging: sensoren die een afbeelding cryptografisch ondertekenen op het exacte moment dat licht en geluid hen raken.

In tegenstelling tot de huidige systemen, die de authenticiteit via de hoofdprocessor van het apparaat afstempelen, waardoor ze kwetsbaar zijn voor onderschepping en manipulatie, sluit dit ontwerp de verificatie rechtstreeks aan bij het vastleggen zelf.

Simpel gezegd zou het het veel moeilijker maken om synthetische media voor echt te laten doorgaan, omdat het bewijs van authenticiteit in de hardware zou worden geboren en niet achteraf zou worden toegevoegd door software die kan worden vervalst. Op die manier kunnen mensen zoeken naar het ‘stempel van de waarheid’ in alle media die overal worden gepubliceerd, van publicaties tot sociale netwerken.

En alles zonder dat stempel moet, zoals Meloni zegt, automatisch worden betwijfeld en genegeerd.

Staten moeten ook actie ondernemen om hun burgers de middelen te geven om elke afbeelding te verwijderen waarin hun gezichten worden gebruikt, door wetten zoals de Digital Millennium Copyright Act in de VS mogelijk te maken. Maar in plaats van gewone mensen te dwingen zelf auteursrechten te eisen, zouden ze in staat moeten zijn om gemakkelijk alle ongeautoriseerde AI-versies van zichzelf op elk openbaar web of sociaal netwerk te verwijderen.

Op dit moment heeft alleen de Deense regering dit gedaan. In een poging om bescherming te bieden tegen AI-klonen van zijn burgers, heeft het land vorig jaar herschreef zijn wettelijke code om te garanderen dat bewoners strikt eigenaar zijn van de rechten op hun biologische gezichten en natuurlijke spreekstemmen.

De Deense minister van Cultuur Jakob Engel-Schmidt vatte het destijds perfect samen: “Mensen kunnen door de digitale kopieermachine worden gehaald en voor allerlei doeleinden worden misbruikt, en dat wil ik niet accepteren.”

De Meloni-zaak, een van de miljoenen, toont eens te meer aan dat de Deense minister van Cultuur voor 200% gelijk heeft toen hij de urgentie van de wet die zijn regering had aangenomen, verklaarde. We moeten dit probleem resoluut stoppen met deze instrumenten en alle andere instrumenten die wetgevers en ingenieurs kunnen bedenken.

Valse beelden kunnen – zolang ze binnen de bestaande wettelijke grenzen blijven – prima naast de werkelijkheid bestaan. Maar de technologiegiganten die van dit probleem profiteren, moeten nu actie ondernemen.