De invloedrijke AI Onderzoeker François Chollet heeft lang betoogd dat het vakgebied intelligentie verkeerd meet, dat populaire benchmarks het vermogen van een model belonen om grote hoeveelheden gegevens te onthouden in plaats van door nieuwe situaties te navigeren en nieuwe vaardigheden te leren. Pas onlangs, met de opkomst van autonome AI-agenten, zijn bedrijven deze kritiek serieus gaan nemen. Dinsdag heeft de Stichting ARC-prijsdat Chollet samen met Zapier-medeoprichter Mike Knoop oprichtte, heeft een nieuwe en moeilijkere versie van zijn benchmark uitgebracht. De test, genaamd ARC-AGI-3, biedt mogelijk de duidelijkste meting tot nu toe van hoe dicht de huidige AI-agenten zijn bij intelligentie op menselijk niveau.

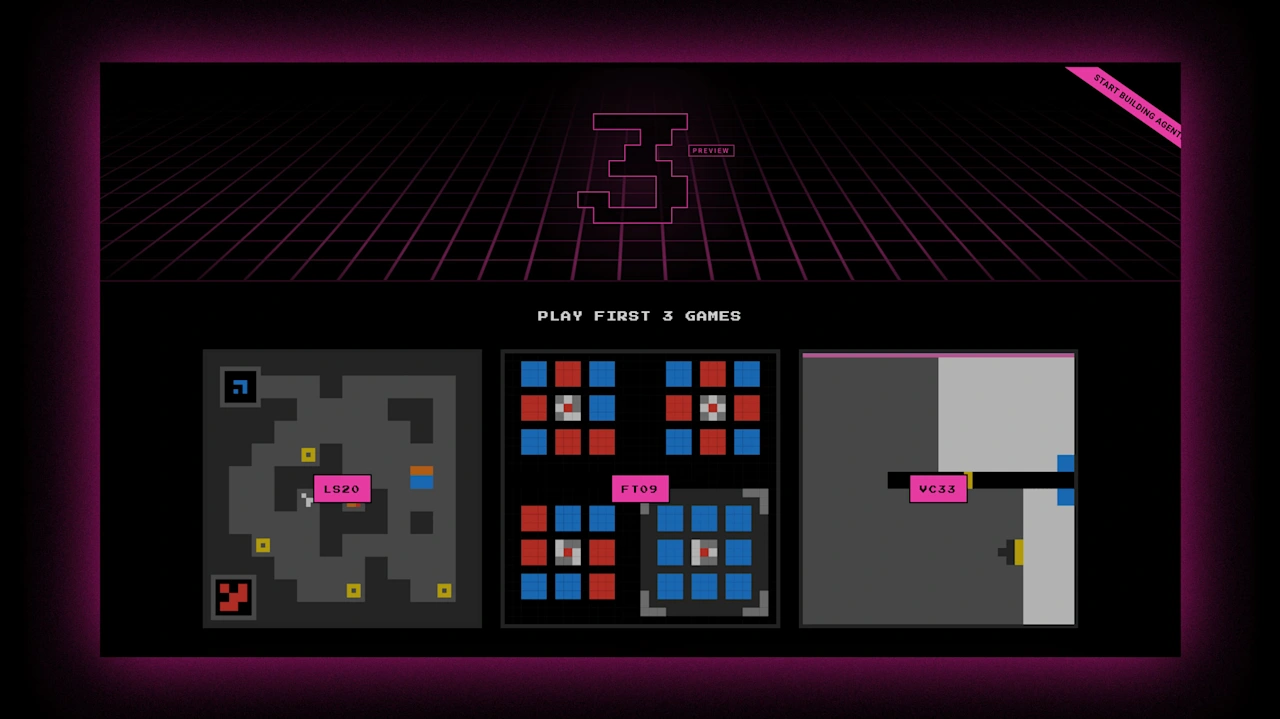

Het bestaat uit meer dan duizend eenvoudige, videogame-achtige scenario’s die zijn ontworpen om on-the-fly redeneringen te meten in plaats van herinneringen op te halen. “Je kunt altijd vaardigheden verwerven door het uit je hoofd te leren door simpelweg een opzoektabel op te slaan van alles wat je moet doen”, zegt Chollet. “Intelligentie is de efficiëntie waarmee je nieuwe dingen gaat begrijpen, nieuwe taken die je nog nooit eerder hebt gezien.”

Zonder instructies moet een agent inzicht krijgen in de spelomgeving en de regels ervan, en die kennis vervolgens toepassen om een strategie te vormen over meerdere stappen naar een uiteindelijk doel. Agenten die deze doelen bereiken met minder, efficiëntere stappen verdienen hogere scores, waarbij hun makers in aanmerking komen voor een prijs van $ 1 miljoen, geheel of gedeeltelijk. Net als in eerdere ARC-benchmarks kunnen mensen relatief gemakkelijk door de taken navigeren, terwijl veel AI-systemen het moeilijk hebben.

Een hoge score op ARC-AGI-3 zou ook kunnen dienen als bewijs van kunstmatige algemene intelligentie (AGI). Om als één geheel het “economisch meest waardevolle werk” te doen dat door mensen wordt uitgevoerd gemeenschappelijke definitie van de AGI-vereisten zullen AI-agenten door onbekende situaties in onbekende omgevingen moeten redeneren. Ze zullen abstracties moeten vormen van ervaringen uit het verleden en deze moeten generaliseren naar nieuwe problemen waarvoor ze niet expliciet zijn opgeleid om ze op te lossen.

“Ik vind het geweldig dat deze benchmark feitelijk de kern vormt van de kloof die bestaat tussen het daadwerkelijk meten van AGI en de standaardset van benchmarksuites die de grote laboratoria en vrijwel iedereen lijken te gebruiken in de ratrace om een week lang 0,5% verbetering te krijgen ten opzichte van elk ander state-of-the-art model”, zegt Andy Konwinski, wiens Laude Instituut heeft $ 25.000 gedoneerd aan de ARC-prijs.

Oorsprong

Toen de eerste ARC-test in 2019 werd uitgebracht, was de transformatorarchitectuur achter de huidige AI-chatbots nog maar twee jaar oud en begonnen de modellen nog maar net coherente reacties op prompts te genereren. Omdat ze nog niet in realtime konden redeneren, hebben ze vrijwel niets van de ARC-1 opgelost puzzelswat de adoptie van de benchmark beperkte.

Chollet zag een fundamenteel probleem met de manier waarop de industrie de vooruitgang evalueerde. Systemen die taken aankonden die beschreven werden als intelligentie op PhD-niveau faalden bij eenvoudige puzzels. “Als de meest geavanceerde AI-systemen het moeilijk hebben, maar een kind kan het wel, dan is dat een groot rood knipperend licht dat je vertelt dat we iets missen, dat er iets heel belangrijks niet klopt”, zegt hij.

De vroege ARC-AGI-1-resultaten wezen ook op een dieper probleem met de de strategie van de industrie voor het verbeteren van de AI: “Ik denk dat ARC letterlijk de belangrijkste ongeslagen benchmark ter wereld is, omdat dit het enige echt duidelijke bewijs is dat het schaalverhaal tegenspreekt dat zo dogmatisch was in de Bay Area in 2023 en 2024”, zegt Knoop. Destijds waren de AI-laboratoria ervan overtuigd dat het blijven uitbreiden van hun modellen, trainingsgegevens en rekenkracht zou leiden tot intelligentiewinst en uiteindelijk tot AGI zou leiden. Maar die systemen bleven statisch tijdens de inferentietijd (tijdens interactie met een gebruiker) en vertrouwden alleen op de vooraf getrainde modelgewichten om antwoorden te genereren.

Schalen naar redeneren

Dat begon te veranderen in 2024, toen AI-laboratoria zich begonnen te concentreren op autonome agenten en het echte werk dat ze zouden kunnen uitvoeren. “Deep learning-modellen bereikten het punt waarop ze zoveel kennis hadden verzameld dat je er een redeneerlaag bovenop kon bouwen”, zegt Chollet. Er was een verschuiving gaande. Nieuwe redeneermodellen, zoals OpenAI’s o1, die in september 2024 werd uitgebracht als onderzoeksvoorbeeld, zouden complexe taken in kleinere delen kunnen opsplitsen en meerdere trajecten naar een oplossing kunnen evalueren.

“Eindelijk probeerde het het probleem van vloeibare intelligentie aan te pakken, dat ontbrak in het deep learning-paradigma”, zegt Chollet. Onderzoekers begonnen meer aandacht te besteden aan ARC omdat het was ontworpen om die mogelijkheid te benutten. “(ARC) werd dit zeer hoge signaalreferentiepunt”, zegt hij. Het o1-model verbeterde ten opzichte van eerdere resultaten en scoorde 21% op ARC-AGI-1, vergeleken met 9% voor GPT-4o, zijn voorganger.

Pas met het OpenAI o3-model, uitgebracht in januari 2025, hadden nieuwe redeneermogelijkheden een significante invloed op de ARC-scores. Het model scoorde tussen de 75% en 87%, afhankelijk van de hoeveelheid gebruikte rekenkracht, en benaderde prestaties op menselijk niveau.

Deze winsten suggereerden dat de ARC-benchmark binnenkort oververzadigd zou kunnen zijn. Naarmate meer modellen hoog gingen scoren, rezen er vragen over de vraag of deze resultaten een echte redenering of optimalisatie voor de benchmark zelf weerspiegelden. AI-laboratoria maakten al gebruik van technische oplossingen en gespecialiseerde systemen om de prestaties te verbeteren. In mei 2025 introduceerde de ARC Prize Foundation ARC-AGI-2 om de test beter bestand te maken tegen die tactieken.

Het o3-model dat ongeveer 87% had gescoord op ARC-AGI-1 daalde aanvankelijk tot slechts 3-4% op ARC-AGI-2.

Verbetering of “benchmaxxing”?

Labs bleven manieren vinden om hun ARC-scores te verbeteren. Ze begonnen gespecialiseerde software-harnassen te creëren die herhaalde redeneringspogingen orkestreerden, deze vervolgens evalueerden en iteratief verbeterden. Onderzoekers debatteerden erover of de softwareharnassen het soort vloeiende redenering weerspiegelen dat ARC moet meten.

Chollet gelooft dat OpenAI in 2025 “tientallen miljoenen” aan rekenkracht heeft uitgegeven om modellen specifiek voor ARC-AGI-2 te trainen, waarbij gebruik wordt gemaakt van openbaar beschikbare ARC-puzzelvoorbeelden om aanvullende trainingsgegevens te genereren. “Dit komt neer op preventief brute forceren… door elke mogelijke taak van tevoren te raden”, zegt hij.

De tactiek werkte in ieder geval: de topscores stegen in december 2025 naar 40-50%, zegt Knoop.

“Ik verwacht dat hetzelfde zal gebeuren met ARC-3, maar met ARC-3 wordt het moeilijker”, zegt Chollet. “Het zal duurder zijn.”

ARC-AGI-3 komt op een cruciaal moment, nu bedrijven en investeerders biljoenen wedden dat AI-agenten een groot deel van het kenniswerk op zich zullen nemen. Modellen worden snel beter, maar het ontbreekt ze misschien nog steeds aan de intuïtie die nodig is om met de complexiteit en onzekerheid van taken in de echte wereld om te gaan. Alles wat minder is, loopt het risico tekort te schieten in de richting van echte autonomie.

Agenten zullen waarschijnlijk een uitstelperiode krijgen waarin menselijke werkers hen trainen en corrigeren. Daarna zullen ze vertrouwen moeten opbouwen en hun verantwoordelijkheden moeten uitbreiden. Als ze falen, kunnen bedrijven aarzelen om ze breder te implementeren.

Zijn de agenten van vandaag goed genoeg om dat vertrouwen te verdienen? Zo niet, hoe weten we dan wanneer dat wel het geval is? ARC-AGI-3 zou deze vragen kunnen helpen beantwoorden.

Het is een goed teken dat de AI-laboratoria goed opletten. “Ik heb veel meer aantrekkingskracht gevoeld van de grenslaboratoria en opwinding over versie drie (ARC-AGI-3) dan ik ooit heb gevoeld over één en twee”, zegt Knoop. De AI-laboratoria zullen eraan werken om hun modellen in 2026 naar hogere scores op de nieuwe benchmark te leiden, en daarbij kunnen ze zich nog meer gaan richten op het opbouwen van de kwaliteiten en capaciteiten die agenten nodig hebben om werk in de echte wereld te doen. “Ik denk dat dit slechts een erkenning is van veel van de grenslaboratoria dat we nieuwe ideeën nodig hebben”, zegt Knoop. ,,We hebben het nog niet allemaal door.”