De AI De industrie heeft een stil verslavingsprobleem: ze is verslaafd aan tokens.

Elke nieuwe generatie agentische AI lijkt te veronderstellen dat het antwoord op de complexiteit is om meer context naar het model te gooien, een langere geschiedenis bij te houden, meer oproepen te genereren, meer tools door te lussen en de tokenmeter de vrije loop te laten.

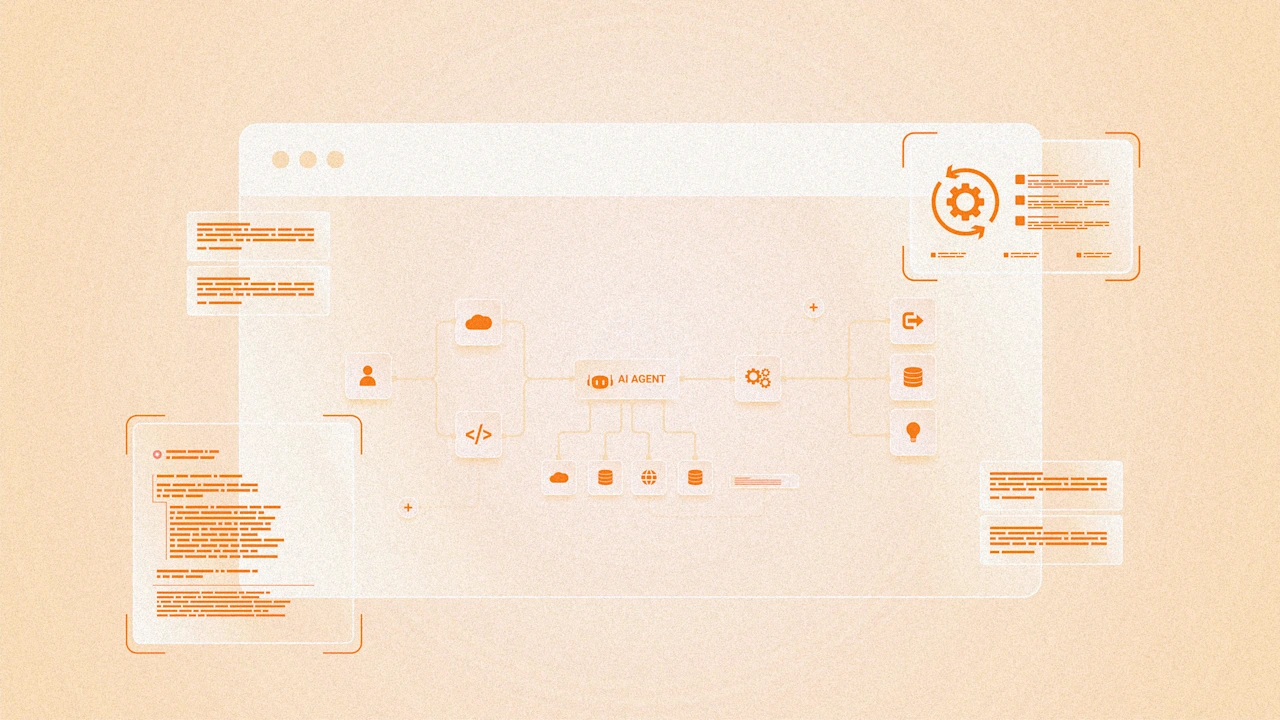

De opkomst van agentische systemen, en nu projecten zoals Open Klauwmaakt die verleiding nog sterker. Zodra je modellen meer autonomie geeft, gebruiken ze niet alleen tokens om vragen te beantwoorden. Ze gebruiken ze om te plannen, na te denken, opnieuw te proberen, samen te vatten, tools aan te roepen, resultaten te inspecteren en zichzelf op koers te houden. OpenClaw zelf beschrijft het product als een ‘agent-native’ gateway met sessies, geheugen, toolgebruik en multi-agent routing over berichtenplatforms – die je precies vertelt waar dit naartoe gaat: meer autonomie, meer orkestratie en, tenzij iemand ingrijpt, veel meer tokenburn.

Dat traject bevalt bijna iedereen die de infrastructuur verkoopt. Als de facturering is gebaseerd op tokens, lijkt een groter tokenverbruik op groei. Als je de rekenkracht achter die tokens verkoopt, ziet het er nog beter uit. Google zei in zijn Winstoproep oktober 2025 dat het meer dan 1,3 biljard maandelijkse tokens over zijn oppervlakken verwerkte, of meer dan 20 keer het volume van een jaar eerder. Nvidia heeft op zijn beurt hard geleund op de economie van inferentie en agentische AIwat zowel de stijgende vraag als de mogelijkheid benadrukt om er steeds meer infrastructuur aan te verkopen.

Maar bedrijven die AI kopen, moeten hier heel anders naar kijken. Vanuit het perspectief van de klant is een explosieve tokengroei niet noodzakelijkerwijs een teken van intelligentie. In veel gevallen is het een teken van inefficiëntie.

Meer tokens zijn niet hetzelfde als meer intelligentie

Het huidige industrieverhaal behandelt symbolische consumptie vaak alsof het een maatstaf voor vooruitgang is. Grotere contextvensters, meer redeneringssporen, meer agentlussen, meer geheugen, meer ophaalmogelijkheden, meer interacties. Het klinkt allemaal indrukwekkend.

Maar een systeem dat elke keer enorme hoeveelheden context moet opnemen en regenereren, is niet noodzakelijkerwijs slimmer. Het kan gewoon slecht ontworpen zijn.

De eigen technische begeleiding van Anthropic maakt dit punt met ongebruikelijke duidelijkheid. Het team betoogt dat context moet worden behandeld als een eindige hulpbron, en dat goede context-engineering betekent dat je “de kleinst mogelijke set tokens met een hoog signaal” moet vinden voor de uit te voeren taak. Dat is geen marginale optimalisatie. Het is een fundamenteel andere filosofie. Er wordt gesteld dat de toekomst niet toebehoort aan systemen die de meeste context kunnen opslokken, maar aan systemen die weten welke context er werkelijk toe doet.

Dat onderscheid wordt steeds belangrijker naarmate agentische workflows zich verspreiden. Zodra een AI-systeem herhaaldelijk mag handelen, tools mag gebruiken, plannen opnieuw mag bekijken en de sessiestatus kan behouden, kan het tokenverbruik snel toenemen. Wat er van buitenaf uitziet als één taak, kan veel verborgen aanwijzingen, subquery’s, samenvattingen en nieuwe pogingen omvatten. Deloitte beschrijft tokens nu als de nieuwe valuta van de AI-economiejuist omdat de structuur van agentische systemen de kostendynamiek zo dramatisch verandert.

En toch gedragen veel bedrijven zich nog steeds alsof schaalgrootte alleen het probleem zal oplossen.

Dat zal niet gebeuren.

Lange context is geen gratis lunch

Een van de meest hardnekkige mythes op het gebied van zakelijke AI is dat als een bepaalde context goed is, meer context beter moet zijn. Die veronderstelling was altijd te simplistisch, en het bewijs ertegen wordt steeds sterker.

Het papier “Verloren in het midden” toonde aan dat taalmodellen vaak moeite hebben om relevante informatie te gebruiken wanneer deze verborgen is in lange contexten, en het beste presteren wanneer belangrijke informatie aan het begin of aan het einde verschijnt. Chroma’s lange-contextevaluatie over 18 modellen ontdekte dat de prestaties van modellen steeds onbetrouwbaarder worden naarmate de invoerlengte toeneemt. Met andere woorden, er is een punt waarop meer tokens niet langer extra intelligentie zijn, maar extra ruis beginnen te worden.

Dit is waar het brute-force-model minder op technologische onvermijdelijkheid begint te lijken en meer op luie architectuur. Als uw antwoord op elke nieuwe vereiste is om meer materiaal in de prompt te stoppen, elke beurt voor altijd te bewaren en elk tussenliggend artefact in het actieve contextvenster te bewaren, bouwt u geen beter AI-systeem. Je bouwt een duurdere, en misschien wel een slechtere.

De echte grens ligt bij context-engineering

De interessantere toekomst is niet groter en hongeriger. Het is selectiever, meer gestructureerdEn doelbewuster. Dat is de reden waarom het belangrijkste opkomende concept in toegepaste AI misschien niet prompt engineering is, maar… contexttechniek.

Anthropic omschrijft context-engineering expliciet als de volgende stap na snelle engineering. OpenAI-aanbiedingen ophalen En snel cachen om te voorkomen dat u herhaaldelijk dezelfde grote hoeveelheden informatie verzendt. Google-aanbiedingen contextcaching voor herhaald gebruik van substantiële initiële context. Richtlijnen van Microsoft over Retrieval-Augmented Generation (RAG) En chunking is eveneens direct: het verzenden van hele documenten of grote delen is duur, kan de tokenlimieten overschrijden en levert vaak slechtere resultaten op dan goed voorbereide ophaalpijplijnen.

Dit zijn geen randtechnieken. Het zijn signalen uit de sector zelf dat het brute-force-tijdperk grenzen kent.

Het patroon is duidelijk. De toekomstige enterprise-stack zal er niet op vertrouwen dat alles wat een bedrijf weet bij elke interactie blindelings opnieuw in een model wordt omgezet. Het zal afhankelijk zijn van een betere architectuur: ophaallagen, toegangscontroles, selectief geheugen, hiërarchische samenvattingen, contextverdichting, caching, routering en sterke queryplanning.

Met andere woorden, het zal afhankelijk zijn van engineering.

Waarom de huidige economie misleidend is

Dit is waar de prikkels verstoord raken.

Modelverkopers kunnen heel gelukkig leven in een wereld waarin klanten geloven dat tokengroei natuurlijk, onvermijdelijk en zelfs wenselijk is. Hoe meer oproepen, hoe meer context, hoe meer lussen, hoe meer inkomsten. Fabrikanten van grafische verwerkingseenheden (GPU’s) bevinden zich eveneens in een goede positie wanneer de vraag naar inferentie blijft stijgen.

En natuurlijk is een deel van die vraag legitiem. Er zijn echte gebruiksscenario’s die meer context, meer modaliteiten en meer geavanceerde gevolgtrekkingen nodig hebben. Maar het zou een vergissing zijn om ‘er bestaat vraag’ te verwarren met ‘er bestaat geen afval’.

zegt Open AI prompt caching kan de latentie met maximaal 80% verminderen en de invoertokenkosten met maximaal 90% voor herhaalde inhoud. Google zegt contextcaching is vooral handig wanneer er herhaaldelijk naar een substantiële initiële context wordt verwezen. zegt Microsoft goede chunking verwijdert irrelevante informatie en verbetert zowel de kosten als de kwaliteit. Geen van deze mogelijkheden zou er toe doen als de brute-force-aanpak al efficiënt was. Hun bestaan alleen al is het bewijs dat slimmere architectuur willekeurige symbolische overstromingen verslaat.

Dat is de reden waarom bedrijven heel voorzichtig moeten zijn met het overnemen van de woordenschat van de verkopers die hen de computers verkopen. “Beter capabel” en “duurder in gebruik” zijn geen synoniemen.

De AI-industrie genereert munt uit de symbolische inflatie. Slimme bedrijven zullen zich hieruit proberen te redden.

Het ondernemingsvoordeel komt voort uit het kennen van uw eigen context

Dit is waar dit artikel meer wordt dan een klacht over de kosten. Omdat de echte kans niet alleen ligt in het verminderen van symbolische facturen. Het gaat om het bouwen van betere systemen.

Een bedrijf dat zijn eigen kennisstructuur, interne machtigingen, workflows, terminologie en beslissingslogica begrijpt, zou niet elke interactie met een AI-systeem moeten benaderen alsof het vanaf het begin met een vreemde praat. Het moet in staat zijn de context op intelligente wijze te ontwerpen: de juiste informatie op het juiste moment ophalen, behouden wat belangrijk is, weggooien wat niet belangrijk is, en de output baseren op zijn eigen interne logica.

Dat is geen kleine verbetering. Het verandert radicaal de economie van enterprise AI.

Als het bedrijfsplatform goed is gebouwd, hoeft het model niet voortdurend de hele wereld in het actieve geheugen te dragen. Het zou moeten werken met een samengestelde, dynamische subset van relevante informatie met een hoog signaal. De agentische ophaalarchitectuur van Microsoft wijst precies in deze richting: gerichte subquery’s, gestructureerde antwoorden, citaten, beveiligingsaanpassingen en kennisbronbewuste basis in plaats van willekeurige contextvulling.

Dit is ook de reden waarom ik eerder in een artikel betoogde dat “AI zal de strategie niet vervangen: het zal deze blootleggen.” Hetzelfde geldt hier. AI zal niet alleen blootleggen of je het nieuwste model hebt aangenomen. Het zal onthullen of uw bedrijf daadwerkelijk zijn eigen informatiearchitectuur begrijpt, of dat het in een mist van losgekoppelde documenten, machtigingen en processen heeft geleefd.

Wat de volgende fase van AI daadwerkelijk zal belonen

De bedrijven die winnen in de volgende fase van kunstmatige intelligentie zullen niet degenen zijn die zich de grootste symbolische rekeningen kunnen veroorloven. Zij zullen degenen zijn die systemen bouwen die ze niet nodig hebben.

Ze zullen tokens behandelen zoals goede ingenieurs omgaan met bandbreedte, levensduur van de batterij of latentie: niet als oneindige bronnen die theatraal moeten worden geconsumeerd, maar als beperkingen die intelligent ontwerp belonen. Ze zullen het grootste deel van de context opslaan wereld modellen. Ze zullen grote modellen gebruiken als grote modellen gerechtvaardigd zijn. Ze zullen terughalen gebruiken als ophalen voldoende is. Ze zullen herhaalde context in de cache opslaan. Ze zullen eenvoudiger werk naar goedkopere modellen routeren. Ze zullen het geheugen beheren in plaats van het te romantiseren. Ze maken onderscheid tussen context die beschikbaar is en context die daadwerkelijk nuttig is.

En, cruciaal, ze zullen stoppen met het verwarren van brute kracht met verfijning. Dat is het deel van het huidige AI-verhaal dat een serieuze correctie verdient. De industrie blijft ons aanmoedigen om ons een toekomst voor te stellen waarin de steeds groeiende symbolische consumptie eenvoudigweg de prijs van vooruitgang is.

Waarschijnlijk niet. Het is, althans gedeeltelijk, de prijs van onvolwassen architectuur. En volwassen architectuur heeft een manier om slechte bedrijfsmodellen te vernietigen.

De toekomst van AI zal niet toebehoren aan de bedrijven die de meeste tokens consumeren. Het zal toebehoren aan degenen die weten hoe ze er minder nodig kunnen hebben.