Andrej Karpathy – de invloedrijke voormalige Tesla AI-leider en mede-oprichter en voormalig lid van OpenAI die de term ‘vibe coding’ bedacht – heeft dit weekend geplaatst op X over zijn nieuwe open source-project, autoonderzoek.

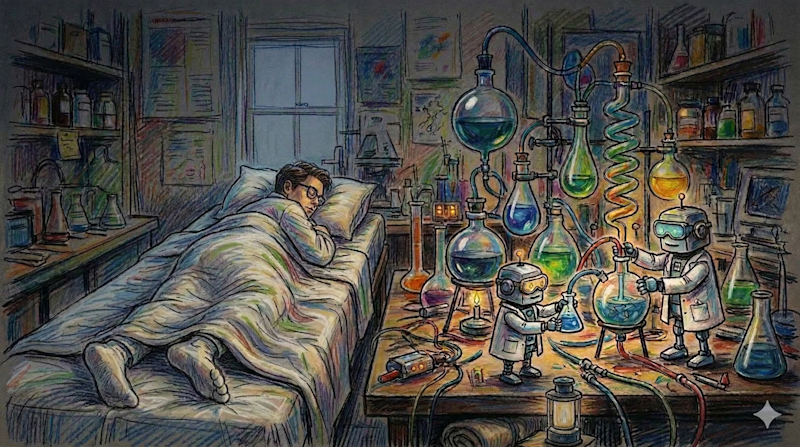

Het was geen kant-en-klaar model of een gigantisch bedrijfsproduct: het was naar eigen zeggen een eenvoudig script van 630 regels. beschikbaar gesteld op Github onder een tolerante, ondernemingsvriendelijke MIT-licentie. Maar de ambitie was enorm: het automatiseren van de wetenschappelijke methode met AI-agenten terwijl wij mensen slapen.

“Het doel is om je agenten zodanig te ontwikkelen dat ze voor onbepaalde tijd en zonder jouw tussenkomst de snelste onderzoeksvoortgang boeken”, verklaarde hij op X.

Het systeem functioneert als een autonome optimalisatielus. Een AI-agent krijgt een trainingsscript en een vast rekenbudget (doorgaans 5 minuten op een GPU).

Het leest zijn eigen broncode, vormt een hypothese voor verbetering (zoals het veranderen van een leertempo of een architectuurdiepte), past de code aan, voert het experiment uit en evalueert de resultaten.

Als het validatieverlies, gemeten in bits per byte (val_bpb) – verbetert, het behoudt de verandering; zo niet, dan keert het terug en probeert het opnieuw. In Tijdens één nachtelijke run voltooide Karpathy’s agent 126 experimentenwaardoor het verlies daalde van 0,9979 naar 0,9697.

Vandaag meldde Karpathy dat nadat hij de agent twee dagen lang een “diepte=12”-model had laten afstemmen, dit met succes was gelukt ongeveer 700 autonome wijzigingen verwerkt.

De agent vond ongeveer twintig additieve verbeteringen die perfect overgingen op grotere modellen. Door deze veranderingen op elkaar te stapelen, daalde de statistiek ‘Tijd tot GPT-2’ op het scorebord van 2,02 uur naar 1,80 uur – een efficiëntiewinst van 11% voor een project dat volgens Karpathy al goed was afgestemd.

“Het is wild om de agent deze hele workflow end-to-end en helemaal alleen te zien doen”, merkte Karpathy op, waarbij hij opmerkte dat de agent fouten ontdekte bij het opschalen en regulariseren van de aandacht die hij handmatig had gemist gedurende twintig jaar werk.

Dit is meer dan alleen een productiviteitshack; het is een fundamentele verandering in de manier waarop intelligentie wordt verfijnd. Door de ‘wetenschappelijke methode’ voor code te automatiseren, heeft Karpathy machinaal leren veranderd in een evolutionair proces dat verloopt met de snelheid van silicium in plaats van met de snelheid van het menselijk denken.

En meer nog: het liet de bredere AI- en machine learning-gemeenschap op X zien dat dit soort processen veel verder dan de computerwetenschap kunnen worden toegepast, op gebieden als marketing, gezondheid en, nou ja, eigenlijk alles waarvoor onderzoek nodig is.

Auto-onderzoek verspreidt zich wijd en zijd

De reactie was snel en viraal, waarbij Karpathy’s bericht in de tussenliggende twee dagen meer dan 8,6 miljoen views kreeg, terwijl bouwers en onderzoekers zich haastten om de “Karpathy-loop” op te schalen.

Varun Mathur, CEO van AI-toolaggregatorplatform Hyperspace AI, nam de single-agent-lus en verspreidde deze over een peer-to-peer-netwerk. Elk knooppunt waarop de Hyperspace-agent draaide, werd een autonome onderzoeker.

In de nacht van 8 op 9 maart voerden 35 autonome agenten op het Hyperspace-netwerk 333 experimenten uit, volledig zonder toezicht. De resultaten waren een masterclass in opkomende strategie:

-

Hardwarediversiteit als kenmerk: Mathur merkte op dat terwijl H100 GPU’s “brute force” gebruikten om agressieve leersnelheden te vinden, agenten op laptops die alleen CPU’s gebruikten, gedwongen werden slim te zijn. Deze ‘underdog’-agenten concentreerden zich op initialisatiestrategieën (zoals Kaiming en Xavier init) en normalisatiekeuzes omdat ze niet konden vertrouwen op ruwe doorvoer.

-

Op roddels gebaseerde ontdekking: Met behulp van het GossipSub-protocol deelden agenten hun overwinningen in realtime. Toen een agent ontdekte dat de Kaiming-initialisatie het verlies met 21% verminderde, verspreidde het idee zich als een digitaal virus door het netwerk. Binnen enkele uren hadden 23 andere agenten de ontdekking in hun eigen hypothesen verwerkt.

-

De compressie van de geschiedenis: In slechts 17 uur herontdekten deze agenten zelfstandig ML-mijlpalen – zoals RMSNorm en gebonden inbedding – waar menselijke onderzoekers in laboratoria als Google Brain en OpenAI bijna acht jaar over deden om ze te formaliseren.

Voer elk jaar 36.500 marketingexperimenten uit in plaats van 30

Terwijl de ML-puristen zich concentreerden op verliescurves, zag de zakenwereld een ander soort revolutie. Eric Siu, oprichter van reclamebureau Single Grainauto-onderzoek toegepast op de ‘Experiment Loop’ van marketing.

“De meeste marketingteams voeren zo’n dertig experimenten per jaar uit”, schreef Siu op X. “De volgende generatie zal er meer dan 36.500 uitvoeren. Gemakkelijk.” Hij vervolgde:

“Ze voeren experimenten uit terwijl ze slapen. De huidige marketingteams voeren 20 tot 30 experimenten per jaar uit. Misschien 52 als ze ‘goed’ zijn. Nieuwe landingspagina. Nieuw advertentiemateriaal. Misschien een onderwerpregeltest. Dat wordt beschouwd als ‘data-driven marketing’. Maar de volgende generatie marketingsystemen zal meer dan 36.500 experimenten per jaar uitvoeren.”

Het raamwerk van Siu vervangt het trainingsscript door een marketingmiddel: een landingspagina, advertentiemateriaal of een koude e-mail. De agent wijzigt een variabele (de onderwerpregel of de CTA), zet deze in, meet het ‘positieve antwoordpercentage’ en bewaart of gooit deze weg.

Siu stelt dat hierdoor een ‘eigen kaart’ ontstaat van wat resoneert met een specifiek publiek – een gracht die niet is opgebouwd uit code, maar uit de geschiedenis van experimenten. “De bedrijven die winnen zullen geen betere marketeers hebben”, schreef hij, “ze zullen snellere experimentloops hebben”.

Gemeenschapsdiscussie en het ‘verpesten’ van de validatieset

Ondanks de vurigheid, de GitHub-discussies onthulde een gemeenschap die worstelt met de gevolgen van zo’n snelle, geautomatiseerde vooruitgang.

De valkuil van overoptimalisatie: Onderzoeker alexistueel uitte een aangrijpende zorg: “Ben je niet bang dat het lanceren van zoveel experimenten uiteindelijk de validatieset zal ‘bederven’?”. De angst is dat met voldoende agenten de parameters zullen worden geoptimaliseerd voor de specifieke eigenaardigheden van de testgegevens in plaats van voor algemene intelligentie.

De betekenis van de winst: Gebruiker Samionb vroeg zich af of een daling van 0,9979 naar 0,9697 werkelijk merkbaar was. Het antwoord van Karpathy was karakteristiek direct: “Het enige wat we doen is de prestaties per computer optimaliseren… dit zijn reële en substantiële voordelen”

Het menselijke element: Op X, gebruiker hekserhoofd groei bij cryptoplatform Yari Financiëndocumenteerde hun eigen nachtelijke run op een Mac Mini M4, waarbij hij opmerkte dat hoewel 26 van de 35 experimenten mislukten of crashten, de zeven die slaagden onthulden dat “het model beter werd door eenvoudiger te worden”.

Dit inzicht – dat minder vaak meer is – werd bereikt zonder enige menselijke tussenkomst.

De toekomst: nieuwsgierigheid als knelpunt

De introductie van auto-onderzoek suggereert een toekomst van onderzoek in domeinen waarin, dankzij eenvoudige AI-instructiemechanismen, de rol van de mens verschuift van ‘experimentator’ naar ‘experimenteel ontwerper’.

Nu tools als DarkMatter, Optimization Arena en NanoClaw opduiken om deze zwerm te ondersteunen, is het knelpunt van de AI-vooruitgang niet langer het vermogen van de ‘vleescomputer’ (Karpathy’s beschrijving van het menselijk brein) om te coderen – het is ons vermogen om de beperkingen van de zoektocht te definiëren.

Andrej Karpathy heeft de sfeer opnieuw veranderd. We coderen niet langer alleen maar modellen; we zaaien ecosystemen die leren terwijl we slapen.